출근길에 읽는 인공지능 책 추천! 실습형으로 배우는 딥러닝과 LLM 모두의 인공지능 파이썬 책

회사에서 LLaMA AI를 활용해 서버를 구축하고 테스트하는 업무를 진행하던 중, 이 책을 읽게 되었습니다. 단순히 기술 매뉴얼처럼 딱딱한 설명이 아니라, AI의 원리와 실무 적용 방법을 쉽게 이해할 수 있도록 풀어내어 굉장히 흥미롭게 읽을 수 있었습니다.

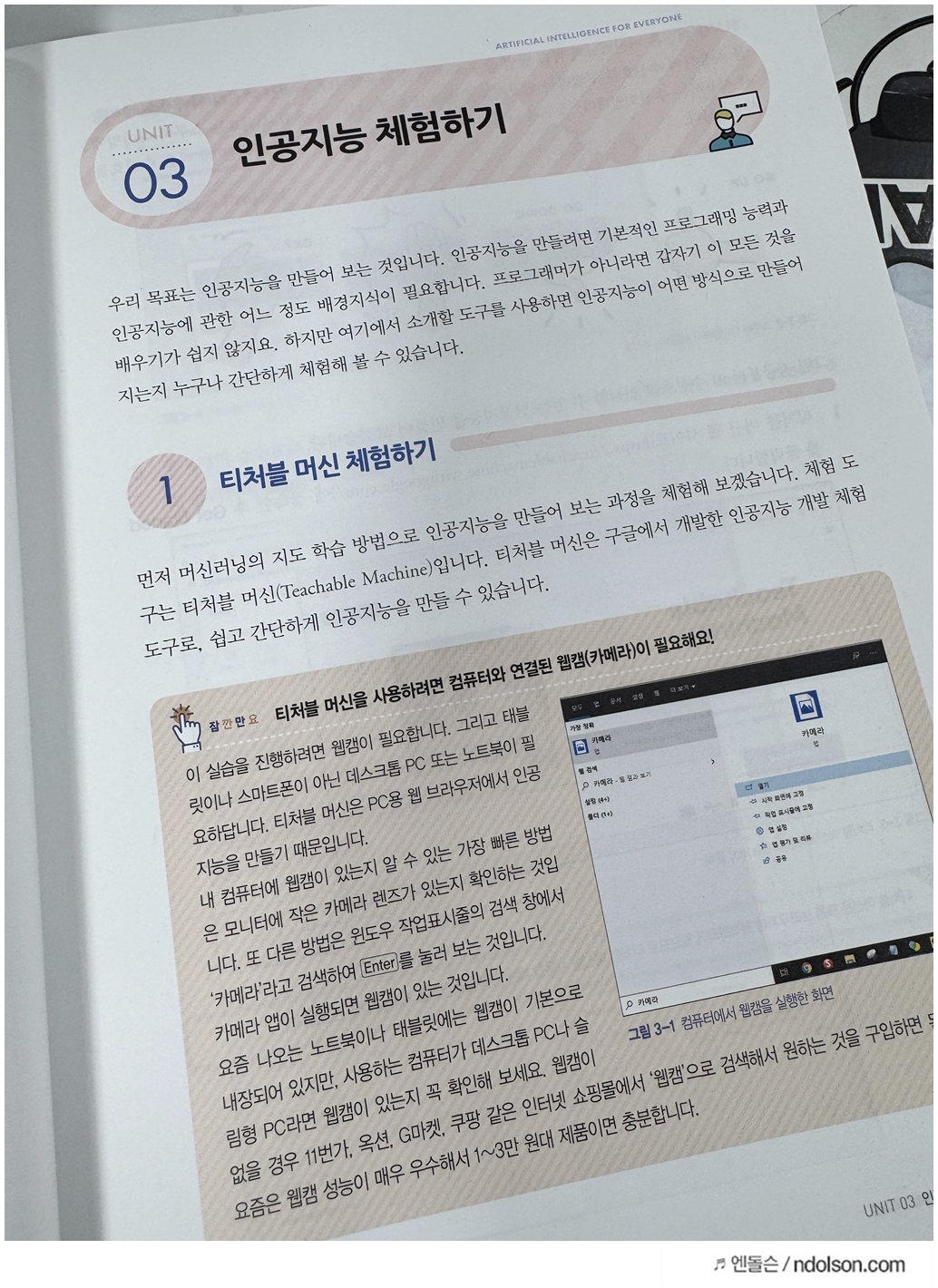

책은 인공지능의 기본 개념에서 시작해, LLM(대규모 언어 모델)의 파인튜닝 과정, 모델 양자화 설정, 신경망의 구조와 작동 원리, 데이터 입력 형태 설정까지 단계별로 잘 구성되어 있습니다. 각 장마다 중요한 개념을 ‘참고만요’ 박스에 요약해 주어, 복잡한 내용을 빠르게 정리할 수 있다는 점이 특히 마음에 들었습니다. 이 덕분에 출퇴근길에 짧게 읽으면서도 핵심 내용을 놓치지 않을 수 있었습니다.

예를 들어, 모델 양자화 부분에서는 BitsAndBytes 라이브러리를 활용해 4비트, 8비트 양자화를 설정하는 법을 소개합니다. 단순히 이론 설명에 그치지 않고, 실제로 bnb_config 설정 코드와 함께 동작 방식을 보여주어, GPU 메모리 절감과 성능 최적화라는 양자화의 장점을 실감할 수 있었습니다. LLaMA 모델을 다룰 때 4비트 양자화를 적용하면 메모리 사용량을 줄이면서도 충분한 성능을 유지할 수 있다는 점은, 실제 서버 환경에서 매우 유용한 팁이었습니다.

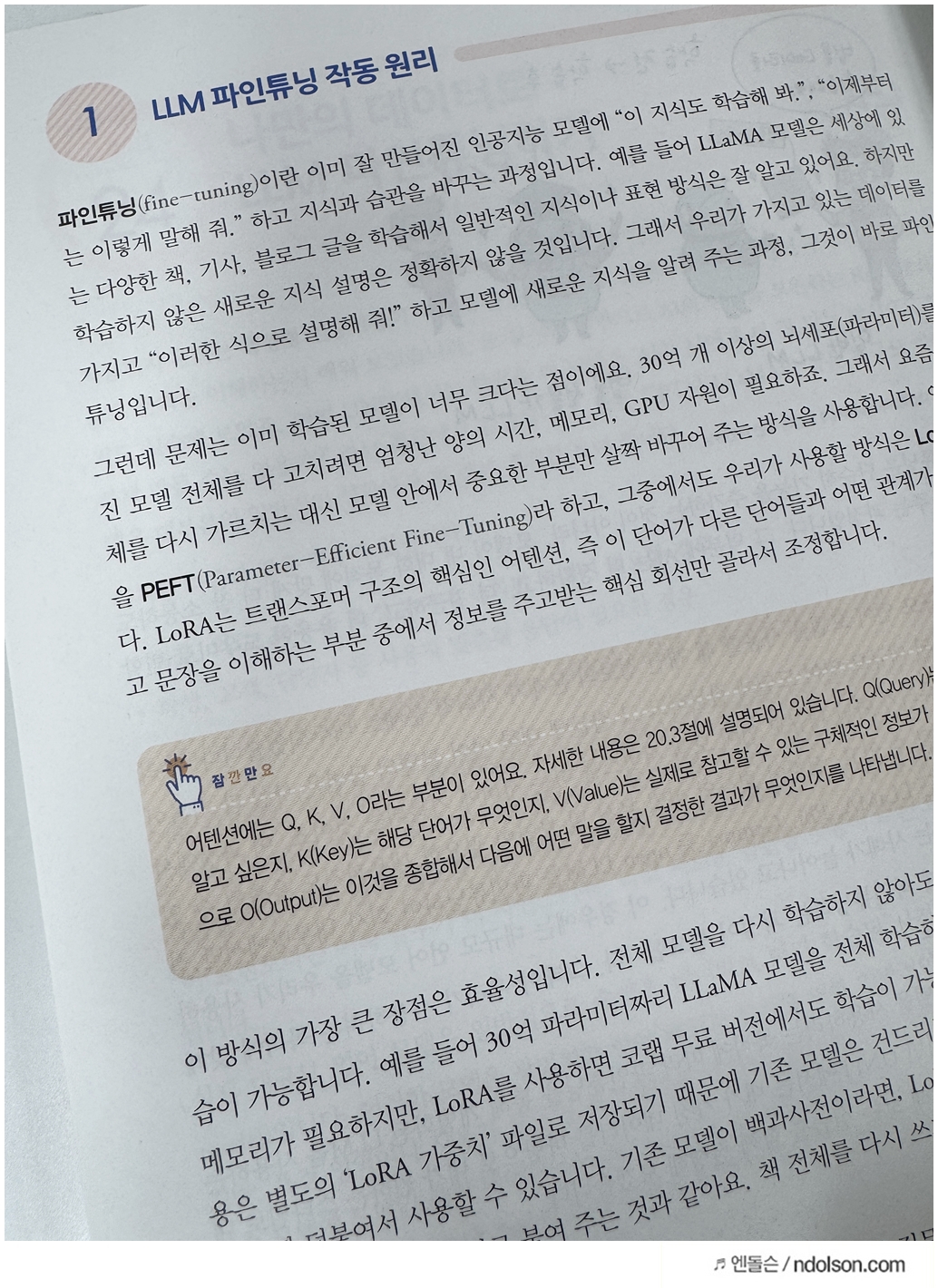

또 LLM 파인튜닝 단원에서는 전체 모델을 재학습시키는 대신 PEFT(Parameter-Efficient Fine-Tuning) 기법과 LoRA 방식을 활용하는 법을 다룹니다. GPU 자원과 시간을 절약하면서도 특정 작업에 맞춘 모델 최적화를 수행할 수 있다는 점이 잘 설명되어 있습니다. 개인적으로 LoRA를 활용한 경량 파인튜닝은 회사 실무에서 적용 가능성이 높아, 큰 도움이 되었습니다.

신경망 학습 원리를 다루는 부분에서는 이항 교차 엔트로피(Binary Crossentropy)로 오차를 계산하고, 역전파(Backpropagation) 과정을 통해 가중치를 수정하는 흐름을 알기 쉽게 시각 자료와 함께 풀어줍니다. 특히, 가중치를 한 번에 전체 수정하는 방식과 여러 층을 차례로 조정하는 방식을 비교해 보여주는 그림은, 딥러닝 구조를 처음 접하는 사람에게도 직관적인 이해를 제공합니다.

데이터 입력 형태 설정 단원에서는 Ratio of training to test data, Noise, Batch size, Epoch 같은 핵심 파라미터의 의미와 조정 방법을 명확하게 짚어줍니다. 단순 정의뿐 아니라, 값이 커지거나 작아질 때 어떤 영향이 있는지도 알려주어, 실험 환경을 설계할 때 참고하기 좋았습니다.

이 책의 장점 중 하나는 코랩(Colab) 환경에서 LLM을 실행하는 방법을 상세히 다루고 있다는 점입니다. GPU 장착 서버가 없는 사람도 클라우드 환경에서 대규모 언어 모델을 실습할 수 있도록 단계별로 안내합니다. 덕분에 하드웨어 제약이 있는 상황에서도 LLM 실습이 가능하다는 자신감을 얻을 수 있었습니다.

전반적으로 이 책은 이론과 실습의 균형이 뛰어난 AI 입문·실무 가이드입니다. 처음 AI를 배우는 사람에게는 복잡한 내용을 쉽게 이해할 수 있게 하고, 이미 실무를 하고 있는 사람에게는 구체적인 구현 팁과 코드 예제를 제공합니다.

저는 출퇴근 시간에 틈틈이 읽으면서, 평소에 막연하게만 알고 있던 AI 개념들이 실제 코드와 어떻게 연결되는지 체계적으로 이해할 수 있었습니다. 단순히 “좋은 책”이라는 말로 끝내기에는 아쉬울 정도로, 실무에 바로 적용 가능한 내용과 이해를 돕는 친절한 설명이 가득 담겨 있었습니다.

AI와 LLM을 실무에 접목하려는 개발자, 혹은 AI 원리를 기초부터 차근차근 배우고 싶은 입문자에게 강력 추천합니다. 이 책은 단순한 이론서가 아닌, “읽으면서 바로 실험해보고 싶은” 실습형 AI 학습서입니다.

인공지능을 구축하고 서비스를 만드는 것이 너무나도 중요합니다. 이제 개발자는 단순 코더가 아니라 AI기술을 잘 응용할 수 있게 생각해야 하는데요. 회사의 서비스에 AI서비스를 결합해서 구축하는 일을 해야 하는데, 이런 개발을 하기 위해서 공부할 때 모두의 인공지능 책은 큰 도움이 되었습니다.